如何使用自然对数计算信息的熵?

参考资料

Moonshot回答

使用自然对数计算信息熵的步骤如下:

-

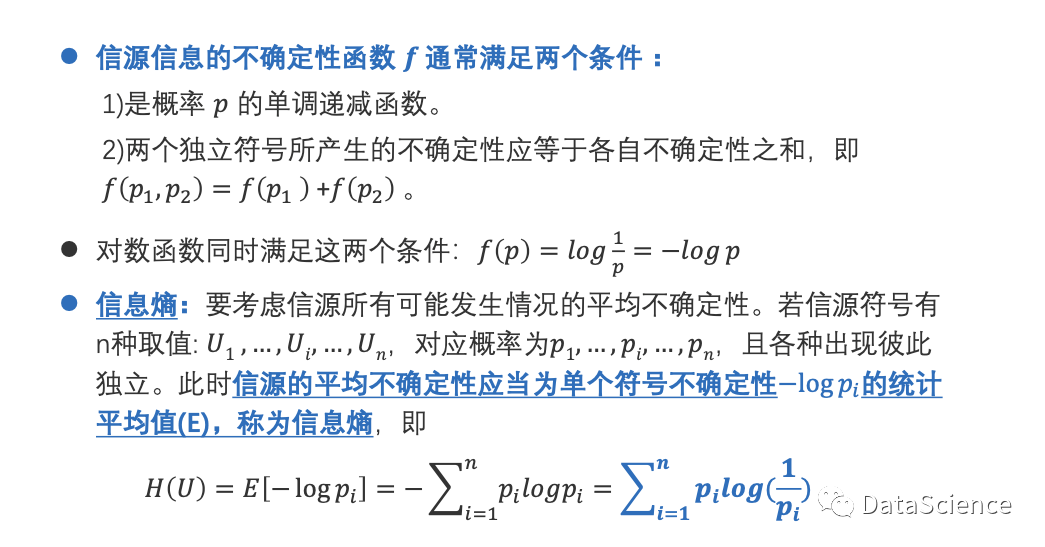

确定概率分布:首先,需要确定信息源中每个事件的概率分布。例如,对于一个离散随机变量X,其可能的取值为x1, x2, ..., xn,相应的概率为P(X=x1), P(X=x2), ..., P(X=xn)。

-

计算对数概率:接着,计算每个概率的自然对数。在MATLAB中,可以使用log函数来计算。自然对数是以e为底的对数,其中e是自然常数,约等于2.71828。

-

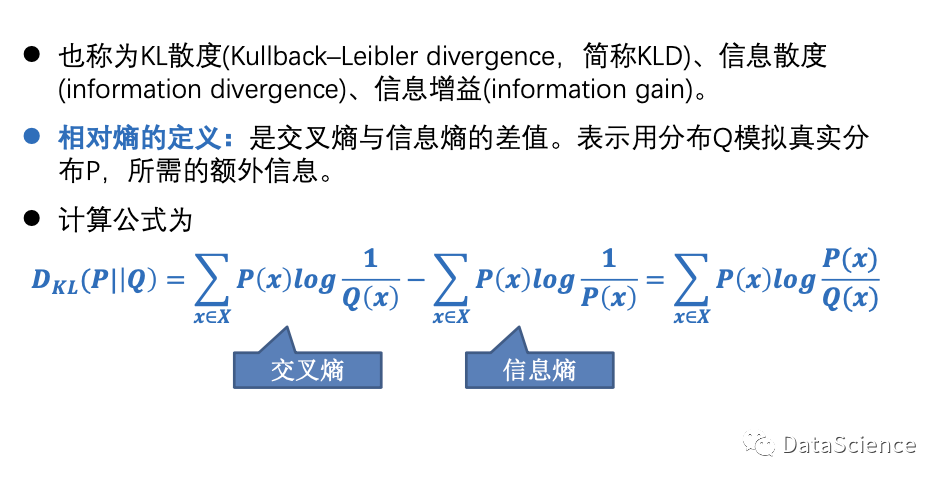

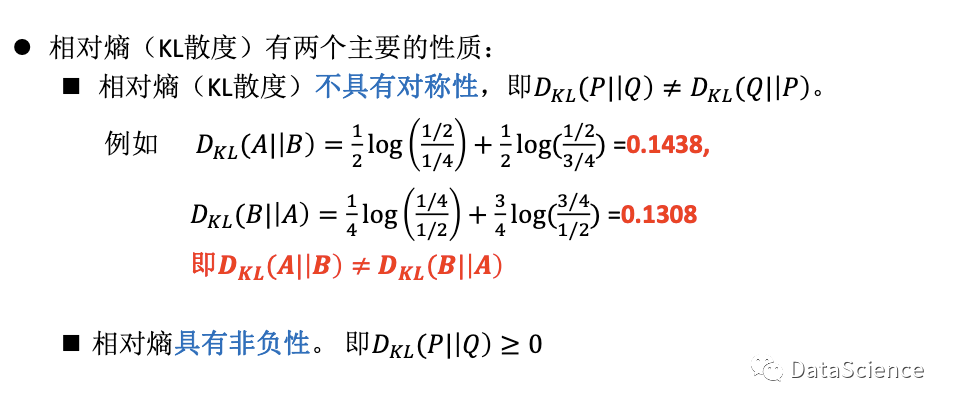

计算信息熵:最后,根据信息熵的定义,将每个对数概率与概率相乘,并将它们相加,再取相反数即可得到信息熵。信息熵的公式为: [ H(X) = -\sum_{i=1}^{n} P(X=x_i) \log P(X=x_i) ] 其中,H(X)表示随机变量X的信息熵。

通过以上步骤,可以计算出信息源的熵,从而衡量信息的不确定性或信息量的大小。熵值越高,表示信息的不确定性越大,信息量也越大。来源