参考资料

参考资料

Moonshot回答

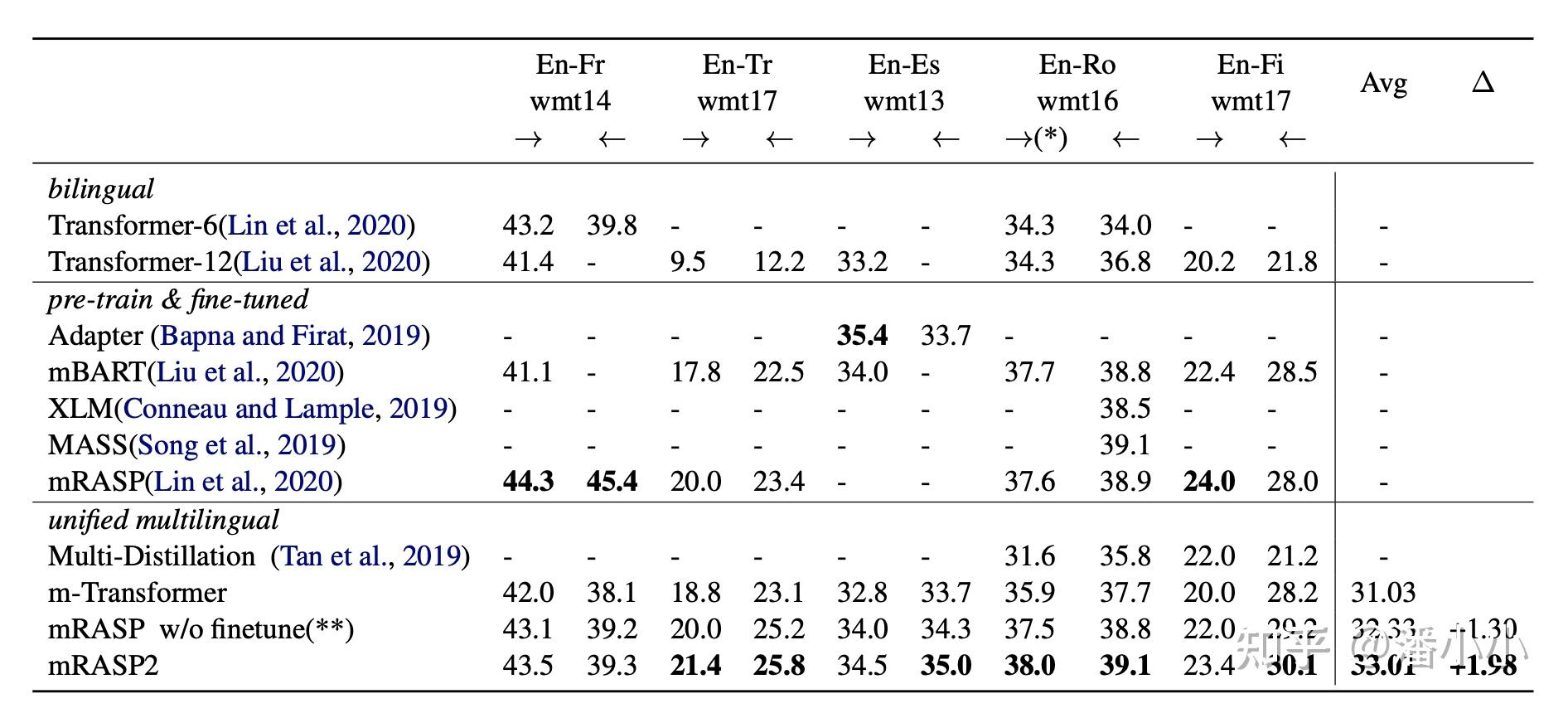

在Few-shot学习中,提供多个翻译示例相比于One-shot学习对模型性能的提升主要体现在以下几个方面:

-

更好的泛化能力:Few-shot学习通过提供更多的样本,使模型能够学习到更丰富的语言特征和上下文信息,从而在面对新的翻译任务时有更好的泛化能力。

-

更有效的学习:多个示例可以帮助模型更好地理解源语言和目标语言之间的映射关系,从而在翻译过程中更准确地捕捉到语言的细微差别。

-

提高翻译质量:Few-shot学习通过少量样本学习,可以快速适应新的翻译任务,提高翻译质量,尤其是在处理罕见或低资源语言对时更为有效。

-

减少对大量标注数据的依赖:Few-shot学习减少了对大量标注数据的需求,这对于资源有限的语言对来说是一个重要的优势。

-

快速适应新任务:Few-shot学习使模型能够快速适应新的翻译任务,这对于需要快速响应市场变化的应用场景非常有价值。

相比之下,One-shot学习虽然在某些情况下也能实现快速学习,但由于样本数量有限,其泛化能力和翻译质量可能不如Few-shot学习。通过引入更多的样本,Few-shot学习能够进一步提升模型的性能,使其在实际应用中更加有效和可靠。

继续提问

相关问题

Jessica Capshaw首次在电视电影《One Angry Juror》中演出了什么角色?

卡洛斯·雷加达斯的电影作品中,哪一部影片参与了第75届威尼斯影展正式竞赛单元?

新学院的建筑风格对牛津大学其他学院有何影响?

格拉斯哥的交通系统有哪些特点?

原始印欧语是如何分化为现代各种语言的?

Karl Schwarzschild的研究有哪些重要成果,它们是如何影响天文物理学的?

为啥巴菲特和老子的投资和生活智慧能够跨越时空地相互印证和融合?

曹魏的屯田制是如何帮助其恢复社会秩序并增强国力的?

为什么1787年的费城会议最终决定制定一部全新的宪法,而不是仅仅修改《邦联条例》?

阿丽亚出演的电视剧《绞刑架下的春天》是什么时候上映的?